基于文本信息借助三維渲染生成視頻的方法及系統與流程

本技術涉及圖像處理,具體涉及基于文本信息借助三維渲染生成視頻的方法及系統。

背景技術:

1、隨著人工智能技術的快速發展,文本到視頻生成已經成為一個熱門研究領域。通過利用ai大模型,可以實現從自然語言文本自動生成與之對應的視頻內容。傳統文生視頻技術原理,即大規模深度神經網絡組成的大模型來實現自然語言文本向目標結果的轉換,期間采取噪音數據擴散出模仿訓練樣本體系文與視頻關聯關系的成果。

2、現有技術中,基于transformer架構的擴散模型所合成畫面幀視頻會存在生成內容分辨率低、一致性差,生成內容不可控等缺陷問題,例如,基于transformer架構的擴散模型所合成畫面幀視頻可能存在異形缺陷,畫面幀視頻會呈現反人類常識的行為或動作。采用大模型生成自然語言格式劇本文本,再通過三維引擎解析格式劇本渲染獲得文生視頻,能夠有效降低大模型合成視頻的不可控性,避免文生視頻中出現一致性錯誤。

3、在模型生成格式文本再到三維渲染生成視頻的過程中,現有技術需要耗費大量的時間對劇本場景中的三維模型進行渲染,提高圖像視頻的真實感,存在輸出內容隨機性,不可控,視頻分辨率低等問題,同時,現有技術渲染會花費大量時間對不必要的模型細節進行深度渲染,導致視頻渲染時間過長,大幅影響視頻生產速度。

技術實現思路

1、為了解決上述技術問題,提供基于文本信息借助三維渲染生成視頻的方法及系統,以解決現有的問題。

2、本技術解決技術問題的方案是提供基于文本信息借助三維渲染生成視頻的方法及系統,包括以下步驟:

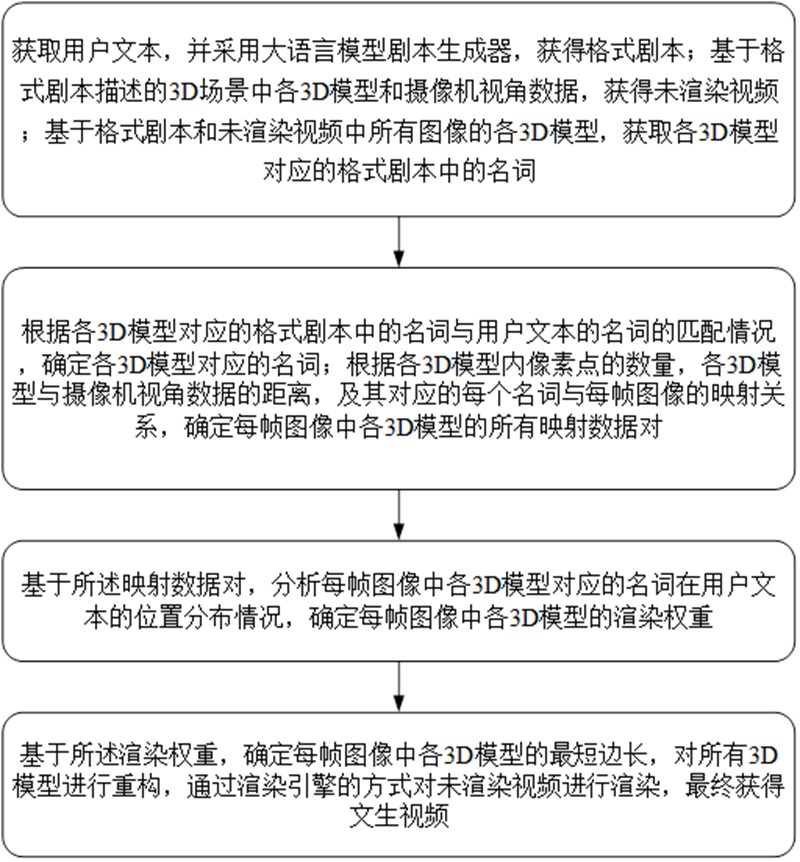

3、第一方面,本技術實施例提供了基于文本信息借助三維渲染生成視頻的方法,該方法包括以下步驟:

4、獲取用戶文本,并采用大語言模型劇本生成器,獲得格式劇本,基于格式劇本描述的3d場景中各3d模型和攝像機視角數據,獲得未渲染視頻;基于格式劇本和未渲染視頻中所有圖像的各3d模型,獲取各3d模型對應的格式劇本中的名詞;

5、根據各3d模型對應的格式劇本中的名詞與用戶文本的名詞的匹配情況,確定各3d模型對應的名詞;根據各3d模型內像素點的數量,各3d模型與攝像機視角數據的距離,及其對應的每個名詞與每幀圖像的映射關系,確定每幀圖像中各3d模型的所有映射數據對;

6、基于所述映射數據對,分析每幀圖像中各3d模型對應的每個名詞在用戶文本中的位置分布情況,確定每幀圖像中各3d模型的渲染權重;

7、基于所述渲染權重,確定每幀圖像中各3d模型的最短邊長,對所有3d模型進行重構,通過渲染引擎的方式對未渲染視頻進行渲染,最終獲得文生視頻。

8、優選的,所述未渲染視頻的獲取方法為:

9、將各3d模型和攝像機焦點位置輸入到三維模型圖像軟件,獲得未渲染視頻,并對未渲染視頻中每幀圖像的各像素點所屬的3d模型進行標記。

10、優選的,所述獲取各3d模型在格式劇本中對應的名詞,包括:

11、對格式劇本采用名詞提取算法,獲得格式劇本中所有名詞;

12、將每個名詞與未渲染視頻中所有圖像中對應的3d模型進行標注,獲得各3d模型在格式劇本中對應的名詞。

13、優選的,所述確定各3d模型對應的名詞,包括:

14、采用名詞提取算法,獲得用戶文本中所有名詞;采用字符串模糊匹配算法,對各3d模型在格式文本中對應的名詞與用戶文本中的名詞進行匹配,將格式文本與用戶文本中匹配的名詞所對應的3d模型,作為各3d模型對應的名詞。

15、優選的,所述確定每幀圖像中各3d模型的所有映射數據對,包括:

16、計算每幀圖像中各3d模型的幾何中心與攝像機視角數據中焦點位置之間的距離,記為位置權重;

17、計算每幀圖像中各3d模型對應標記的像素點的數量與所述位置權重的乘積,作為每幀圖像中各3d模型的呈現權重;

18、將各3d模型在所有圖像的所述呈現權重按照圖像幀序號順序排列,組成呈現權重序列,獲取各3d模型的呈現權重序列中的所有極大值點;

19、分析各3d模型對應的每個名詞在用戶文本中的位置關系,確定各3d模型對應的每個名詞的相對文本位置;

20、分析每個名詞的相對文本位置與所述極大值點所對應的圖像幀序號之間的差異情況,結合極大值點對應的所述呈現權重,確定各3d模型對應的每個名詞與各極大值點的映射判別值;

21、針對每個名詞與所有極大值點的所述映射判別值,選取每個名詞的映射判別值的最大值對應的極大值點及圖像幀序號,將每個名詞與對應圖像幀序號組成一個二維數組,獲得每幀圖像中各3d模型的所有映射數據對。

22、優選的,所述確定各3d模型對應的每個名詞的相對文本位置,包括:

23、針對各3d模型對應的每個名詞,確定每個名詞中第一個字符在用戶文本中的字符位置;

24、將每個名詞的所述字符位置與用戶文本的所有字符數量之間的比值,作為各3d模型對應的每個名詞的相對文本位置。

25、優選的,所述確定各3d模型對應的每個名詞與各極大值點的映射判別值,包括:,其中,為第m個3d模型對應的第r個名詞與第k個極大值點的映射判別值,為第m個3d模型對應的第r個名詞的相對文本位置,為未渲染視頻的所有圖像的數量,為第m個3d模型的呈現權重序列中第k個極大值點所對應的圖像幀序號,為第m個3d模型的呈現權重序列中第k個極大值點所對應的呈現權重,為向上取整函數,為預設大于零的數值。

26、優選的,所述確定每幀圖像中各3d模型的渲染權重,包括:

27、計算每幀圖像所有3d模型的所有所述映射數據對對應的名詞的所述相對文本位置的均值,作為每幀圖像的視頻文本位置;

28、將每幀圖像中各3d模型對應的每個名詞的所述相對文本位置與所述視頻文本位置之間的差異,記為第一差異;

29、將每幀圖像中各3d模型對應的所有名詞的所述第一差異的和,作為每幀圖像中各3d模型的渲染權重。

30、優選的,所述確定每幀圖像中各3d模型的最短邊長,對所有3d模型進行重構,包括:

31、獲取每幀圖像中所有3d模型的渲染權重的最大值;

32、將每幀圖像中各3d模型的所述渲染權重與所述最大值的比值,記為第一比值;

33、將所述第一比值與預設邊長閾值的和,作為每幀圖像中各3d模型的最短邊長;

34、對各3d模型和對應的最短邊長輸入到三角剖分算法中,獲得表面重構的3d模型;采用渲染引擎的方式對重構后3d模型進行渲染。

35、第二方面,本技術實施例還提供了基于文本信息借助三維渲染生成視頻的系統,包括存儲器、處理器以及存儲在所述存儲器中并在所述處理器上運行的計算機程序,所述處理器執行所述計算機程序時實現上述任意一項所述基于文本信息借助三維渲染生成視頻的方法的步驟。

36、本技術至少具有如下有益效果:

37、本技術通過大語言模型將用戶文本轉換為格式劇本,并基于格式劇本與3d數據庫,獲得未渲染視頻,其有益效果在于通過大語言模型能夠得到規定格式的劇本,降低視頻幀出現缺陷的可能性,減少不可控因素的發生;本技術通過每幀圖像中各3d模型的呈現權重以及映射數據對,分析了各3d模型在圖像中的所占權重,以反映各3d模型呈現在對應圖像的重要性,考慮文本的出現與對應圖像之間的映射關系,以反映文本的位置與圖像呈現時刻的對應情況;進一步通過每幀圖像中各3d模型的渲染權重,分析各3d模型與對應圖像之間的關聯強度,從而對圖像中不同關聯強度的3d模型進行不同程度的渲染;基于所述渲染權重,確定每幀圖像中各3d模型的最短邊長,對所有3d模型進行重構,完成對不同3d模型的差別化渲染,加快視頻渲染速度,解決渲染時間過長的問題;相比于傳統transformer架構的擴散模型,本技術通過將用戶文本轉化為格式劇本,并結合3d模型,以渲染引擎的方式進行渲染,獲得文生視頻,使得生成的視頻內容具有高度確定性和唯一性,減少了視頻生成過程中的不確定性,確保最終文生視頻的質量和預期效果,提高渲染視頻質量,降低渲染功耗,同時可以根據需求調整渲染精度,隨時調整視頻分辨率。

- 還沒有人留言評論。精彩留言會獲得點贊!