一種基于2D數字人的實時對話分析方法及系統與流程

本發明屬于2d數字人實時對話分析,尤其涉及一種基于2d數字人的實時對話分析方法及系統。

背景技術:

1、隨著人工智能技術的發展,2d數字人在實時對話分析中的應用日益廣泛,尤其在虛擬助手、教育和娛樂等領域中,2d數字人通過對用戶行為的實時分析,為用戶提供個性化的交互體驗。在這些應用場景中,系統通常依賴用戶場景視頻來捕捉用戶的動態行為,并根據用戶與環境中的物體交互情況進行分析和響應。現有的2d數字人系統往往基于對用戶與物體的空間位置關系和運動軌跡的監控來判斷物體是否屬于用戶的主動交互對象。當場景中出現突發動態交互物體時,系統會評估該物體是否為用戶主動操縱的結果,以此決定是否需要將其納入與用戶的交互內容中。通常,這種評估主要基于物體進入用戶視野的路徑、速度、距離等物理屬性。

2、然而,現有技術在判斷突發動態交互物體是否為用戶主動操控方面存在較大的局限性。當前的系統通常僅依靠物體與用戶之間的簡單空間位置關系(如物體距離用戶的遠近、物體進入視野的角度和路徑)或基本的運動模式(如物體的速度和方向)來做出初步判斷。這種基于位置和軌跡的分析方法缺乏對用戶具體行為和意圖的細化考量,因而容易受到多種外部因素的干擾。例如,當一個物體被風吹入或因碰撞意外滾入用戶場景時,現有系統可能僅根據物體靠近用戶的路徑,誤判其為用戶主動操控的結果。對于用戶復雜的多重動作(如手部的自然擺動和無意觸碰)以及環境中其他動態因素的影響,現有方法難以有效分辨用戶的真實意圖(如意圖抓取或揮手拒絕)和無意行為,從而導致系統判斷失誤,影響2d數字人與用戶的對話互動的連貫性和準確性。

技術實現思路

1、本發明的目的在于提供一種基于2d數字人的實時對話分析方法及系統,旨在解決背景技術中提出的問題。

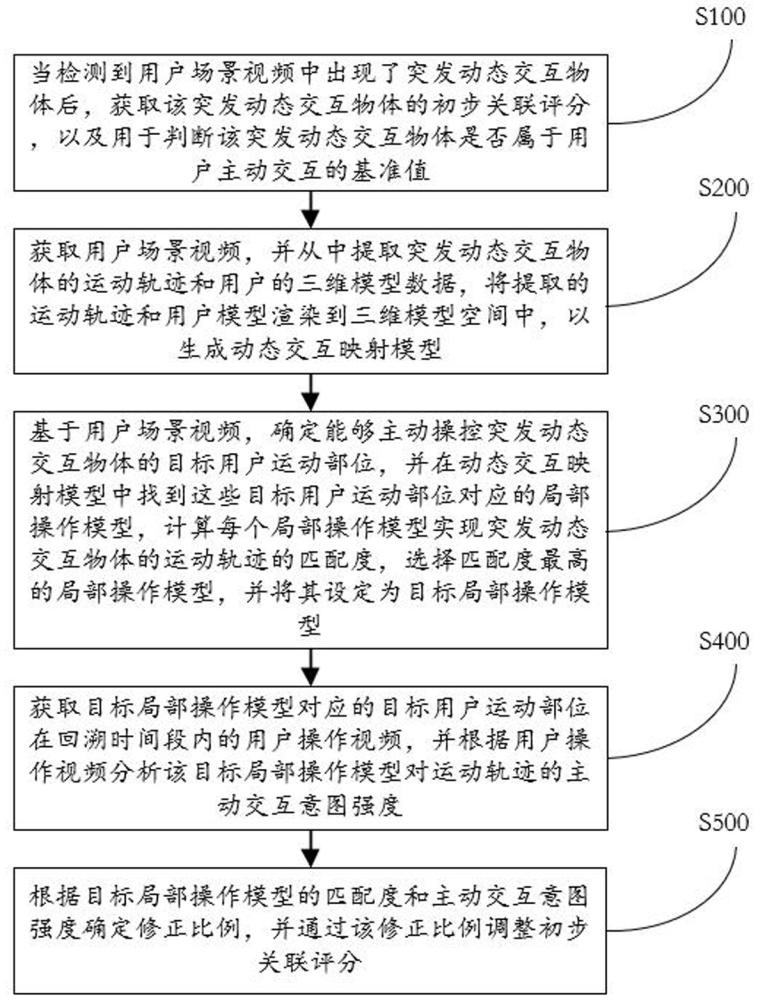

2、本發明是這樣實現的,一種基于2d數字人的實時對話分析方法,所述方法包括:

3、當檢測到用戶場景視頻中出現了突發動態交互物體后,獲取該突發動態交互物體的初步關聯評分,以及用于判斷該突發動態交互物體是否屬于用戶主動交互的基準值;

4、獲取用戶場景視頻,并從中提取突發動態交互物體的運動軌跡和用戶的三維模型數據,將提取的運動軌跡和用戶模型渲染到三維模型空間中,以生成動態交互映射模型;

5、基于用戶場景視頻,確定能夠主動操控突發動態交互物體的目標用戶運動部位,并在動態交互映射模型中找到這些目標用戶運動部位對應的局部操作模型,計算每個局部操作模型實現突發動態交互物體的運動軌跡的匹配度,選擇匹配度最高的局部操作模型,并將其設定為目標局部操作模型;

6、獲取目標局部操作模型對應的目標用戶運動部位在回溯時間段內的用戶操作視頻,并根據用戶操作視頻分析該目標局部操作模型對運動軌跡的主動交互意圖強度;

7、根據目標局部操作模型的匹配度和主動交互意圖強度確定修正比例,并通過該修正比例調整初步關聯評分。

8、作為本發明實施例技術方案進一步的限定,基于用戶場景視頻,確定能夠主動操控突發動態交互物體的目標用戶運動部位,并在動態交互映射模型中找到這些目標用戶運動部位對應的局部操作模型,計算每個局部操作模型實現突發動態交互物體的運動軌跡的匹配度,選擇匹配度最高的局部操作模型,并將其設定為目標局部操作模型的步驟包括:

9、基于用戶場景視頻,識別并確定能夠主動操控突發動態交互物體的目標用戶運動部位,并提取其在三維模型空間中的坐標信息;

10、根據各個目標用戶運動部位在三維模型空間中的坐標信息,確定各個目標用戶運動部位在動態交互映射模型中對應的局部操作模型;

11、計算每個局部操作模型實現突發動態交互物體的運動軌跡的匹配度,選擇匹配度最高的局部操作模型,并將其設定為目標局部操作模型。

12、作為本發明實施例技術方案進一步的限定,計算每個局部操作模型實現突發動態交互物體的運動軌跡的匹配度,選擇匹配度最高的局部操作模型,并將其設定為目標局部操作模型的步驟包括:

13、預測每個局部操作模型的可執行運行軌跡,并識別可執行運行軌跡與突發動態交互物體的運動軌跡的相似度;

14、將局部操作模型的可執行運動軌跡與突發動態交互物體的運動軌跡的相似度定義為局部操作模型實現突發動態交互物體的運動軌跡的匹配度;

15、對所有局部操作模型實現突發動態交互物體的運動軌跡的匹配度進行篩選,并將匹配度最高的局部操作模型設定為目標局部操作模型。

16、作為本發明實施例技術方案進一步的限定,能夠主動操控突發動態交互物體的目標用戶運動部位具體指代用戶身體中可直接操控或影響突發動態交互物體的部分,包括手部、嘴部、手臂、腿部或腳部。

17、作為本發明實施例技術方案進一步的限定,獲取目標局部操作模型對應的目標用戶運動部位在回溯時間段內的用戶操作視頻,并根據用戶操作視頻分析該目標局部操作模型對運動軌跡的主動交互意圖強度的步驟包括:

18、獲取用戶場景視頻,并截取回溯時間段內的用戶操作視頻;

19、對用戶操作視頻進行分析,識別目標局部操作模型對應的目標用戶運動部位的關鍵動作特征;

20、評估關鍵動作特征與目標用戶運動部位的運動軌跡之間的趨勢關聯值,并將該趨勢關聯值定義為目標局部操作模型對運動軌跡的主動交互意圖強度。

21、作為本發明實施例技術方案進一步的限定,根據目標局部操作模型的匹配度和主動交互意圖強度確定修正比例,并通過該修正比例調整初步關聯評分的步驟包括:

22、對目標局部操作模型的匹配度和主動交互意圖強度進行加權處理,并通過線性組合計算得到修正比例;

23、將初步關聯評分與修正比例相乘,計算出優化后的關聯評分;

24、將優化后的關聯評分與基準值進行比較,以判斷突發動態交互物體是否屬于用戶主動交互。

25、一種基于2d數字人的實時對話分析系統,所述系統包括:突發動態交互物體識別模塊、動態交互映射模型生成模塊、目標局部操作模型確定模塊、主動交互意圖強度生成模塊以及初步關聯評分調整模塊,其中:

26、突發動態交互物體識別模塊,用于當檢測到用戶場景視頻中出現了突發動態交互物體后,獲取該突發動態交互物體的初步關聯評分,以及用于判斷該突發動態交互物體是否屬于用戶主動交互的基準值;

27、動態交互映射模型生成模塊,用于獲取用戶場景視頻,并從中提取突發動態交互物體的運動軌跡和用戶的三維模型數據,將提取的運動軌跡和用戶模型渲染到三維模型空間中,以生成動態交互映射模型;

28、目標局部操作模型確定模塊,用于基于用戶場景視頻,確定能夠主動操控突發動態交互物體的目標用戶運動部位,并在動態交互映射模型中找到這些目標用戶運動部位對應的局部操作模型,計算每個局部操作模型實現突發動態交互物體的運動軌跡的匹配度,選擇匹配度最高的局部操作模型,并將其設定為目標局部操作模型;

29、主動交互意圖強度生成模塊,用于獲取目標局部操作模型對應的目標用戶運動部位在回溯時間段內的用戶操作視頻,并根據用戶操作視頻分析該目標局部操作模型對運動軌跡的主動交互意圖強度;

30、初步關聯評分調整模塊,用于根據目標局部操作模型的匹配度和主動交互意圖強度確定修正比例,并通過該修正比例調整初步關聯評分。

31、作為本發明實施例技術方案進一步的限定,所述目標局部操作模型確定模塊具體包括:

32、目標用戶運動部位識別單元,用于基于用戶場景視頻,識別并確定能夠主動操控突發動態交互物體的目標用戶運動部位,并提取其在三維模型空間中的坐標信息;

33、局部操作模型確定單元,用于根據各個目標用戶運動部位在三維模型空間中的坐標信息,確定各個目標用戶運動部位在動態交互映射模型中對應的局部操作模型;

34、目標局部操作模型確定單元,用于計算每個局部操作模型實現突發動態交互物體的運動軌跡的匹配度,選擇匹配度最高的局部操作模型,并將其設定為目標局部操作模型。

35、作為本發明實施例技術方案進一步的限定,所述主動交互意圖強度生成模塊具體包括:

36、用戶操作視頻截取單元,用于獲取用戶場景視頻,并截取回溯時間段內的用戶操作視頻;

37、關鍵動作特征識別單元,用于對用戶操作視頻進行分析,識別目標局部操作模型對應的目標用戶運動部位的關鍵動作特征;

38、主動交互意圖強度生成單元,用于評估關鍵動作特征與目標用戶運動部位的運動軌跡之間的趨勢關聯值,并將該趨勢關聯值定義為目標局部操作模型對運動軌跡的主動交互意圖強度。

39、作為本發明實施例技術方案進一步的限定,所述初步關聯評分調整模塊具體包括:

40、修正比例計算單元,用于對目標局部操作模型的匹配度和主動交互意圖強度進行加權處理,并通過線性組合計算得到修正比例;

41、初步關聯評分調整單元,用于將初步關聯評分與修正比例相乘,計算出優化后的關聯評分;

42、用戶主動交互判斷單元,用于將優化后的關聯評分與基準值進行比較,以判斷突發動態交互物體是否屬于用戶主動交互。

43、與現有技術相比,本發明通過當檢測到用戶場景視頻中出現了突發動態交互物體后,獲取該突發動態交互物體的初步關聯評分,以及用于判斷該突發動態交互物體是否屬于用戶主動交互的基準值;獲取用戶場景視頻,并從中提取突發動態交互物體的運動軌跡和用戶的三維模型數據,將提取的運動軌跡和用戶模型渲染到三維模型空間中,以生成動態交互映射模型;基于用戶場景視頻,確定能夠主動操控突發動態交互物體的目標用戶運動部位,并在動態交互映射模型中找到這些目標用戶運動部位對應的局部操作模型,計算每個局部操作模型實現突發動態交互物體的運動軌跡的匹配度,選擇匹配度最高的局部操作模型,并將其設定為目標局部操作模型;獲取目標局部操作模型對應的目標用戶運動部位在回溯時間段內的用戶操作視頻,并根據用戶操作視頻分析該目標局部操作模型對運動軌跡的主動交互意圖強度;根據目標局部操作模型的匹配度和主動交互意圖強度確定修正比例,并通過該修正比例調整初步關聯評分。

44、在2d數字人系統識別到突發動態交互物體后,能夠通過兩個關鍵維度來優化對該物體是否屬于用戶主動交互的判斷。首先,系統基于用戶場景視頻,識別出可能主動操控突發物體的目標用戶運動部位(如手部、腳部等),并在動態交互映射模型中找到與這些部位相對應的局部操作模型。接著,系統計算每個局部操作模型實現物體運動軌跡的匹配度,選擇匹配度最高的模型作為目標操作模型,以此評估該運動部位與物體之間的相關性。其次,系統獲取回溯時間段內的用戶操作視頻,分析目標局部操作模型的行為特征和用戶對物體的交互軌跡,量化主動交互意圖的強度。通過結合匹配度和主動交互意圖強度兩個維度,系統可以動態修正用于判斷物體是否屬于用戶主動交互的初始基準值。

45、選擇這兩個維度的原因在于,它們能夠全面反映用戶與突發物體之間的交互情況。匹配度評估了用戶身體部位與物體之間的物理位置和運動關系,確保識別出的目標操作模型與物體軌跡的關聯性。主動交互意圖強度則捕捉了用戶的行為動機和意圖,通過分析用戶動作與物體交互的趨勢,揭示用戶對物體的關注或操作意圖。這種方法避免了僅依賴單一因素判斷的局限性,通過整合空間位置、動作特征和行為意圖,增強了系統判斷的準確性和可靠性,從而為2d數字人對話建立更智能、更自然的交互基礎。

- 還沒有人留言評論。精彩留言會獲得點贊!