基于特征融合和Transformer的多模態圖像配準方法與流程

本發明屬圖像處理,具體涉及一種基于特征融合和transformer的多模態圖像配準方法。

背景技術:

1、多模態圖像指由不同成像機制的傳感器獲取的圖像,由于其成像機制、波段、時相各不相同,得到的圖像數據在維度、尺寸、分辨率、幾何特征等方面也都存在一定的差異,往往造成顯著的幾何畸變和非線性強度差異。因此,跨模態圖像之間的配準一直都是圖像配準的研究難點,如何消除這些差異并且挖掘兩幅圖像潛在的特征聯系是圖像配準領域亟待解決的問題。

2、盡管有許多性能較好、有前景的配準方法被提出,但在多模態配準領域,要想提出一個在精度、魯棒性和效率方面具有良好性能的通用方法,仍然存在一些問題。由于多模態圖像特征異構,圖像間存在典型的“五差異”(成像特性差異、尺度差異、旋轉差異、噪聲差異、景觀差異等)和“三不同”(不同環境、不同天氣、不同天候等),給高精度匹配帶來了極大的困難。如何準確定義和描述同名特征,如何對同名特征進行表征都是較大的難點。而且,多模態圖像之間的同名特征難以提取,即使提取到同名特征,也會由于視角不同和環境不同出現不完整、難對應的情況。基于特征的方法的核心挑戰是多模態圖像對的特征檢測和匹配,由于多模態圖像對之間存在顯著的非線性強度差異,這種情況下,針對一般視覺應用提出的許多廣泛使用的特征匹配器就會失效,或者由于僅使用局部圖像信息而在假定匹配中出現大量的異常值(誤匹配)。

3、近年來,深度學習方法在圖像處理領域得到了廣泛的應用,在圖像配準領域,其主要思想是從大量的訓練數據中自動學習圖像的特征信息,用卷積神經網絡的強大表達能力來代替基于直接感知或經驗的手工設計檢測器和描述符。然而受限于cnn架構的固有局限性,其感受野大小有限,忽略了圖像中的長距離依賴關系,無法有效捕捉到圖像中的遠程空間信息。依靠數據驅動,深度學習模型可在圖像形變相對嚴重時,實現良好的配準效果,因此,設計出合理的網絡模型對于提升多模態配準的準確度而言至關重要。

技術實現思路

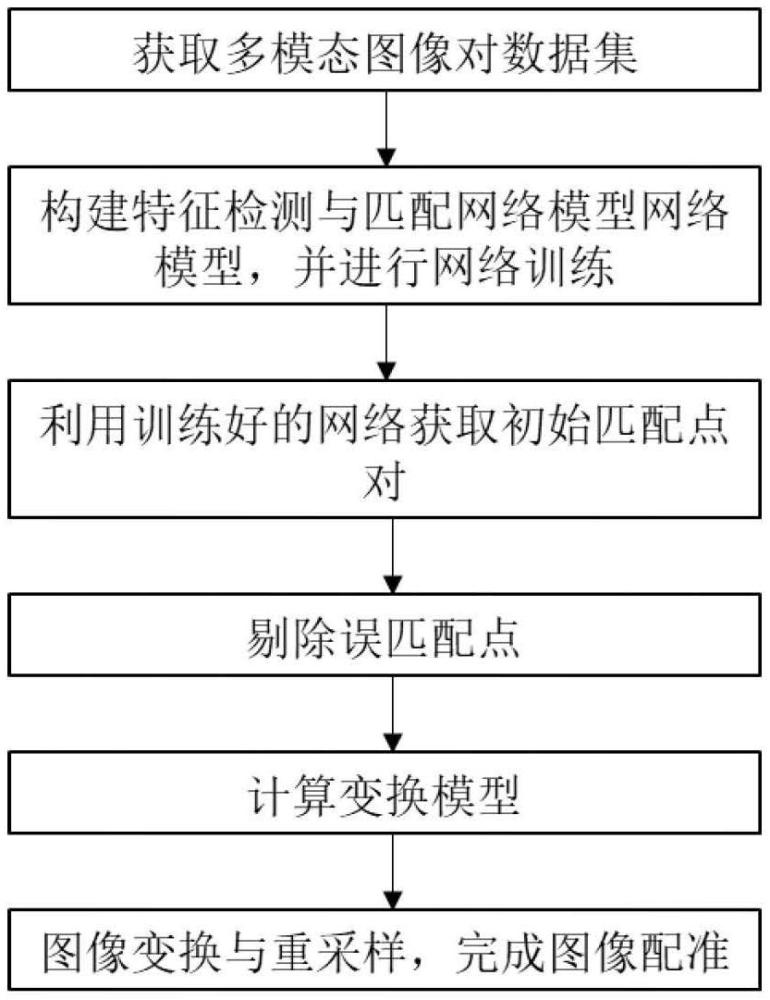

1、為了克服現有技術的不足,本發明提供一種基于特征融合和transformer的多模態圖像配準方法。首先,獲取多模態圖像對數據集;然后,構建特征檢測與匹配網絡模型網絡模型,以獲取的數據集中的圖像對為輸入量,以其匹配點對為輸出量,對該網絡進行訓練;接著,利用訓練好的網絡提取得到待配準圖像的匹配點對,并利用gsm算法進行誤匹配點剔除,得到最終的空間變換模型;最后,對待配準圖像進行圖像變換,并通過薄板樣條插值法得到配準結果。本發明結合了深度學習方法和幾何特征方法的優點,在挖掘深層語義信息的同時保留了空間細節信息,能夠確保特征匹配的準確性和有效性,提高多模態圖像配準的精度和魯棒性。

2、一種基于特征融合和transformer的多模態圖像配準方法,其特征在于步驟如下:

3、步驟1:獲取多模態圖像對數據集,包含同一場景的若干組光學-光學、光學-紅外、光學-深度、光學-地圖、光學-sar圖像、白天-夜晚圖像對,每個圖像對中一幅作為參考圖像,另一幅作為待配準圖像;

4、步驟2:構建特征檢測與匹配網絡模型,以步驟1獲取的數據集中的圖像對為輸入量,以其匹配點對為輸出量,對該網絡進行訓練;

5、步驟3:對于兩幅給定的待配準圖像,將其輸入到步驟2訓練好的特征檢測與匹配網絡,得到圖像的匹配點對;

6、步驟4:利用gsm算法對匹配點對進行誤匹配點剔除,再根據剩余匹配點對按下式計算得到空間變換模型:

7、

8、其中,(xref,yref)表示參考圖像中點的坐標,(xsen,ysen)表示待配準圖像中對應匹配點的坐標,s表示縮放因子,θ表示旋轉角度,tx和ty分別表示水平和垂直方向的平移量;

9、步驟5:利用步驟4獲得的空間變換模型對待配準圖像進行變換計算,得到經過空間變換的圖像特征點,再采用薄板樣條插值法對圖像特征點進行插值處理,得到圖像的配準結果。

10、具體地,步驟1中所述的光學-光學圖像對為多視角、跨時相的光學圖像對。

11、具體地,所述的特征檢測與匹配網絡模型主要包括多尺度特征提取網絡、特征金字塔網絡和transformer編碼器-解碼器模塊,輸入圖像對的兩幅圖像,分別利用多尺度特征提取網絡提取其不同尺度的特征,得到每幅圖像的若干個不同尺度的特征圖,再利用特征金字塔網絡的特征融合模塊每幅圖像的高層特征圖和低層特征圖逐步融合,生成融合特征圖,最后,利用transformer編碼器-解碼器模塊對兩幅圖像的融合特征圖進行特征匹配,得到圖像的初始匹配點對。

12、具體地,所述的多尺度特征提取網絡采用改進的resnet50網絡,所述的改進是指在原始的resnet50網絡模型基礎上增加一個卷積模塊,卷積模塊由1024個1×1的卷積核、3×3的卷積核和4096個1×1卷積核串聯構成。

13、具體地,所述的特征金字塔網絡包括自底向上和自頂向下的兩條路徑,其中,自底向上的路徑是多尺度特征提取網絡,通過卷積網絡前饋計算得到圖像的若干個不同尺度的特征圖,自頂向下的路徑是通過一個特征融合模塊將高層特征圖與低層特征圖逐步融合,生成最終的融合特征圖,所述的特征融合模塊還通過學習一個語義偏移場實現高層特征圖和低層特征圖的語義對齊,其處理過程如下:

14、

15、其中,fo表示融合后的特征圖,表示元素相加,si表示第i個尺度下的低級特征圖,di表示第i個尺度下的高級特征圖,和表示對特征圖進行編碼,fl和fh分別為低層特征圖和高層特征圖的編碼結果,w(·)表示特征對齊函數,其參數為θ。

16、具體地,所述的transformer編碼器-解碼器模塊由編碼器和解碼器構成,編碼器和解碼器均采用6層結構,其中,每個編碼器層te包含一個8頭的自注意力層和mlp層,每個自注意力層和前饋神經網絡之間均采用殘差連接;每個解碼器層td包含一個8頭的交叉注意力層和與te相同的mlp層,并采用前歸一化殘差單元,所述的前歸一化殘差單元是指在mlp層之前進行層歸一化。

17、具體地,特征檢測與匹配網絡模型網絡的損失函數l為:

18、

19、其中,e表示配準結果與參考圖像的誤差,i和i′分別表示參考圖像和待配準圖像,x表示參考圖像的特征點,x′表示待配準圖像的特征點,l1為重投影損失,l2為循環一致性損失,l1和l2的計算表達式分別如下:

20、l1=||x'-fφ(x|i,i')||22?????????????????????????(6)

21、l2=||x-fφ(fφ(x|i,i')|i,i')||22?????????????????????(7)

22、其中,fφ(·)表示通過網絡模型得到的匹配結果。

23、具體地,gsm算法的處理過程為:輸入兩幅圖像的n個特征對應關系參考圖像的初始匹配點集為待配準圖像的對應匹配點集為按下式計算代價函數值:

24、

25、其中,c表示代價值,sin表示內點集,λ為閾值,設為0.9,d(·,·)表示兩點間的距離;

26、引入一個n×1維的二元向量p,向量中每個元素pi表示第i個對應(xi,yi)的匹配正確性,pi=1為內點,pi=0為外點,代價值小于閾值λ的視為內點,代價值大于閾值λ的視為外點,最終得到正確匹配關系s*={ipi=1,i=1,…,n}。

27、本發明的有益效果是:由于結合了深度學習方法和幾何特征方法的優點,在挖掘深層語義信息的同時保留了空間細節信息,保證了特征匹配的準確性和有效性,進而提高了多模態圖像配準的精度和魯棒性。本發明方法不僅可用于多模態圖像配準,還可進一步應用于其它相關領域。

- 還沒有人留言評論。精彩留言會獲得點贊!