一種面向電網線路無人機巡檢的魯棒特征匹配方法

本發明涉及電力巡檢,具體涉及一種面向電網線路無人機巡檢的魯棒特征匹配方法。

背景技術:

1、特征匹配是估計空間位姿和場景結構建模的關鍵步驟,在包括但不限于機器人視覺導航、三維點云重建和深度立體視覺等領域已得到廣泛應用。在電力技術領域,通過特征匹配建立可靠的圖像對應關系,可以利用純視覺信息快速重建電網線路通道環境的點云地圖,對于推進室外作業場景下智能化快速巡檢平臺建設具有重要意義。目前的巡檢方案主要依靠大型無人機搭載激光掃描平臺,對線路通道進行孿生建模,然后根據點云地圖規劃航線,并使用小型無人機進行巡檢。然而,激光建模成本高昂且需要離線解算,不僅耗時長且費用高。尤其是配網電網線路,由于城建規劃和環境頻繁變動,在臺賬校對和規劃巡檢航跡時,同源數據一致性的維護成本巨大。而對于主網電網線路,需要通過長跨度架空線路進行遠距離電力傳輸,沿線經過大量山地丘陵,無人機在這些地區由于缺乏衛星信號,難以實現準確定位。因此,亟需研究一種面向電網線路無人機巡檢的魯棒特征匹配方法,為通道環境快速建模提供可靠的視覺對應關系。

2、現有的特征匹配方法大多遵循檢測器-匹配器的基本結構,其中檢測器和匹配器分別用于提取和匹配關鍵點。文獻“yi,k.moo,et?al,learning?to?find?goodcorrespondences,in?proceedings?of?the?ieee?conference?on?computer?vision?andpattern?recognition,2018,pp.2666-2674”在使用視覺描述符進行預匹配的基礎上,提出將關鍵點的位置坐標輸入排列等變網絡,然后利用pointnet預測每對關鍵點間的內點似然分數,排除了匹配中冗余的離群關鍵點。為了擺脫預匹配對模型匹配上限的約束,文獻“sarlin,p-e,et?al,superglue:learning?feature?matching?with?graph?neuralnetworks,in?proceedings?of?the?ieee/cvf?conference?on?computer?vision?andpattern?recognition,2020,pp.4938-4947”將特征匹配轉換為圖匹配問題,通過構建圖像關鍵點之間的完全圖,進行圖消息傳遞以交換視覺紋理和背景目標的信息,然而將全部關鍵點視為可匹配點,不僅導致匹配準確度受冗余關鍵點影響,還使得其帶來巨大的時間復雜度。文獻“shi,yan,et?al,clustergnn:cluster-based?coarse-to-fine?graph?neuralnetwork?for?efficient?feature?matching,in?proceedings?of?the?ieee/cvfinternational?conference?on?computer?vision,2022,pp.12517-12526”提出一種基于聚類的改進思路。利用特征點之間的相似度將全部的特征點分成若干個聚類簇,分別在每個聚類簇內構建圖并進行信息傳遞和聚合,從而避免了完全圖匹配帶來的影響。但其并未對電網線路巡檢進行適配,各聚類間并無顯示語義差別,匹配關注點容易偏向樹木、行人和建筑等巡檢無關目標。

3、因此,本發明針對上述問題,提出了一種面向電網線路無人機巡檢的魯棒特征匹配方法。對于無人機采集的圖像數據,提出一種基于深度估計和線性檢測的線路關鍵點提取方法,將關鍵點約束在具有線性結構的檢測目標附近,同時,利用線性片段的紋理無關性,提高匹配方法的魯棒能力。對于提取的線性關鍵點,提出一種基于多層隨機種子的圖匹配網絡進行特征匹配,將消息傳遞集中在種子集中,使圖結構更加稀疏,避免了檢測無關目標的關鍵點冗余匹配帶來的誤差,提高了模型匹配準確性。該方法適用于電網線路巡檢,能夠對營配調不同口徑的圖模進行同源維護,完善航線規劃,在無衛星信號情況下實現無人機定位,有助于解決當前電網線路巡檢方案的諸多痛點問題。

技術實現思路

1、本發明提出一種面向電網線路無人機巡檢的魯棒特征匹配方法,實現無人機巡檢目標的魯棒匹配,主要包括:提出一種基于深度估計和線性檢測的線路關鍵點提取方法,保留紋理無關的線性結構關鍵點,在此基礎上,設計一種基于多層隨機種子的圖匹配網絡,對提取關鍵點計算種子集,通過種子集進行圖消息傳遞,剔除匹配冗余的關鍵點,實現電力線路通道環境下,無人機巡檢目標的魯棒匹配。

2、具體內容如下:

3、(1)提出一種基于深度估計和線性檢測的線路關鍵點提取方法:提取輸入圖像的點位置信息和線性結構,基于電桿、配電箱和電線等檢測目標的線性特征,利用深度信息對線性框圖空間映射范圍外的點進行剔除,并將提取線性片段的端點作為剔除補償,添加到提取點集合中,從而實現巡檢目標關鍵點魯棒提取。提取點集合中的點經過描述符計算后,連同特征描述符作為提取關鍵點結果,參與

技術實現要素:

(2)計算。

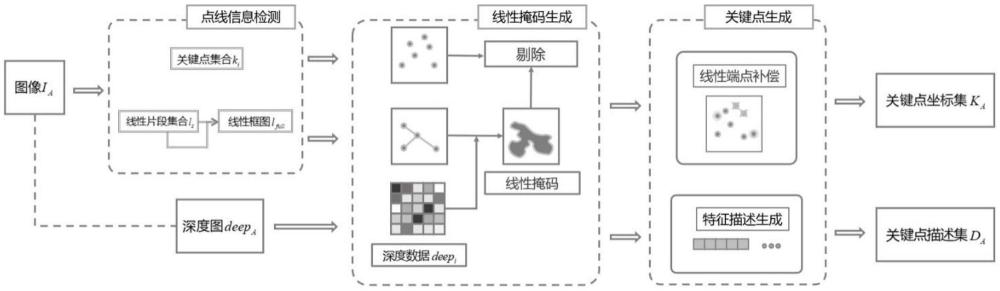

4、所提出的基于深度估計和線性檢測的線路關鍵點提取方法主要分為三個階段:點線信息檢測、線性掩碼生成、關鍵點生成。如圖1所示,點線信息檢測階段首先創建輸入圖像i的一組提取點集合ki,i∈{0,1,…,n}和線性片段集合ls,s∈{0,1,…,s},其中點檢測器使用sift算法檢測角點的坐標,線檢測器使用lsd算法預測檢測目標的線性連接片段。

5、線性掩碼生成階段首先需要將碎片化的線性片段合并為具有全局線性結構的線性框圖lfull,通過計算片段端點的歐氏距離do,將距離小于閾值thd的相鄰端點進行合并,重新生成對應線段描述,同時保留端點ks的原始位置。該過程將碎片的局部片段轉換成連通的全局線框,通過合并相鄰端點使提取結構特征整體一致。對于線性框圖lfull,利用深度估計計算其在像素坐標下的空間映射距離dspace,將lfull范圍內點的空間映射覆蓋區域取并,作為線性掩碼。對于點i,其空間映射距離dspace(i)的計算公式如下:

6、

7、其中,hi和wi是圖像i的長寬,deepi是提取點i像素坐標在深度圖中對應位置的亮度,即該點在空間中距離拍攝原點的距離,deepmax是深度圖中最大亮度,表示拍攝圖像中最遠的距離,θscale是設置的空間縮放比例,默認為0.25。當線性框圖經過深度圖亮度高的區域時,意味著其空間位置遠離巡檢無人機,此時空間在像素坐標下映射距離較短,線性掩碼覆蓋區域縮小。

8、關鍵點生成階段首先通過線性掩碼對提取點集合k中的點進行過濾,并將之前保留的片段端點ks加入提取點集合中,獲得關鍵點像素坐標集ki,i∈{a,b}。然后,對ka和kb的每個關鍵點,在其局部鄰域內計算梯度方向和幅值,生成128維的sift描述符dim=(dim1,dim2,…,dim128)。為了避免巡檢過程由于天氣和飛行狀況,導致拍攝圖像出現透視變化,各關鍵點特征描述符差異增大,在原始sift描述符的基礎上進行歸一化處理,提高匹配魯棒性,得到關鍵點特征描述集di,i∈{a,b},其計算公式如下:

9、

10、(2)提出一種基于多層隨機種子的圖匹配網絡:通過構建關鍵點種子集,在訓練過程中,對匹配圖像的種子關鍵點進行稀疏圖消息傳遞,降低不匹配關鍵點的冗余信息誤差,并結合完全圖分配模塊,增強多層種子生成過程中全局關鍵點的匹配相關性表達,從而有效提高線路關鍵點匹配精度。本發明所提出的基于多層隨機種子的圖匹配網絡,其輸入為發明內容(1)中所述ki和di,其中i∈{a,b},目的是建立匹配圖像ia和ib中關鍵點的精準匹配。

11、如圖2所示,基于多層隨機種子的圖匹配網絡主要包括三個模塊:初始種子生成模塊、種子圖注意力模塊和完全圖分配模塊。初始種子生成模塊使用di計算特征描述符間的歐氏距離,關鍵點根據描述符距離進行相互最近鄰匹配,得到關鍵點的近似匹配s’,并將距離比的倒數,即第一最近鄰距離和第二最近鄰距離的比率,作為關鍵點的匹配得分。本發明方法從近似匹配s’中取匹配得分前k位的關鍵點作為初始種子集(0)s,構建稀疏圖,輸入種子圖注意力模塊。此外,為了充分利用高維信息強大的語義表達能力,關鍵點的位置坐標通過多層感知機進行位置編碼,獲得128維的編碼位置信息encoder_k=(k1,k2,…,k128)。將關鍵點編碼位置信息和特征描述符按元素相加,作為初始圖特征(0)x,輸入種子圖注意力模塊。關鍵點i的初始圖特征可定義為:

12、(0)xi=dimi+encoder_ki,?其中encoder_ki=mlp(ki)?(3)

13、種子圖注意力模塊由包括多個種子圖注意力層和種子重生成機制在內的多個結構組成,在每個種子圖注意力層內通過種子集構建稀疏圖進行特征下采樣,種子關鍵點根據稀疏圖結構進行圖消息傳遞,加強種子關鍵點間的視覺紋理和背景信息表達能力。在種子圖注意力層間根據上采樣種子圖特征的匹配結果(l)pij重新生成種子集(l)s,使得種子集最大程度近似正確匹配結果。具體來說,如圖3所示,輸入到種子圖注意力層的完全圖特征(l)x經過種子集(l)s索引,得到稀疏圖特征(l)x1,利用加權注意力聚合θmess進行特征下采樣,并通過圖消息傳遞方法fatt((l)x1,(l)x,1)更新圖特征,得到下采樣圖特征(l)x2。對于要更新的向量x和要關注的向量y,圖消息傳遞的過程可以描述為:

14、xnext=fatt(x,y,w)=x+mlp([x||θmess])????????(4)

15、θmess=softmax(qkt)wv,其中w∈(0,1]?(5)

16、在種子圖注意力層內,對下采樣圖特征依次進行自注意力和交叉注意力計算,增強特征對于同一圖像不同關鍵點間的差異性,和不同圖像匹配關鍵點相似性的語義表達能力。對于圖特征和基于pointnet網絡預測種子關鍵點間的內點似然分數(l)γ,通過圖消息傳遞方法fatt((l)x,(l)x3,(l)γ)進行特征上采樣,完成完全圖特征更新。在種子圖注意力層間,依賴完全圖分配模塊計算層間匹配分配矩陣(l)pij,將(l)pij兩個維度上匹配得分都在前k位的關鍵點作為種子,重新生成種子集(l)s。

17、完全圖分配模塊根據輸入的完全圖特征,計算各關鍵點的匹配置信度δ和匹配相關性cij,其中i∈ia,j∈ib。在此基礎上,完全圖分配模塊通過dual-softmax進行分配預測,并結合置信度結果輸出匹配分配矩陣pij。如圖4所示,本發明的完全圖分配模塊通過計算圖特征向量間的點積,得到圖像ia和ib中各關鍵點的匹配相關性矩陣cij,關鍵點i的匹配置信度δi表征該關鍵點存在對應匹配點的概率,假如在另一張圖中沒有該點的對應匹配點,則δi→0。在種子圖注意力層中,由于匹配關鍵點未完全確定,理應保留關鍵點不進行過濾,層間匹配分配矩陣(l)pij由cij進行dual-softmax后直接生成。對于輸出層,需要剔除匹配冗余的關鍵點,減少誤匹配概率,通過置信度閾值thδ過濾冗余關鍵點,得到關鍵點掩碼序列和經過向量相乘后得到輸出匹配分配矩陣pij。分配預測的定義如下:

18、

- 還沒有人留言評論。精彩留言會獲得點贊!