一種圖片內容批量識別與自動分類歸檔的方法與流程

本發明涉及地理信息,尤其涉及一種圖片內容批量識別與自動分類歸檔的方法。

背景技術:

1、在現代信息技術的迅猛發展下,圖像數據在各個領域中的應用越來越廣泛。無論是在醫療影像、交通監控、安防系統,還是在社交媒體和電子商務平臺上,海量圖像數據的生成和處理已經成為不可忽視的挑戰。現有技術在圖像內容識別與分類歸檔方面已經取得了一定的進展,但在面對大規模圖像數據集和復雜的應用場景時,仍然存在許多亟待解決的問題。

2、首先,圖像預處理和特征提取是圖像內容識別的基礎環節。現有技術通常采用傳統的圖像處理方法,如高斯濾波進行去噪、直方圖均衡化進行圖像增強,以及基于邊緣檢測的圖像分割技術。然而,這些方法在處理大規模圖像數據集時往往效率低下,難以滿足實時處理的需求。傳統特征提取方法,如sift(尺度不變特征變換)、surf(加速魯棒特征)和hog(方向梯度直方圖),雖然在一定程度上能夠提取圖像的局部特征,但其計算復雜度高,且在面對多樣化和復雜的圖像內容時,特征的表達能力和魯棒性有限。

3、其次,單一模態的數據無法全面表征圖像內容。在圖像分類過程中,僅依賴圖像的視覺特征可能導致分類準確率不足。例如,在電子商務平臺中,產品圖片通常伴隨有文本描述,如產品名稱、規格和描述信息。現有的圖像分類方法往往忽略了這些文本信息,從而導致分類模型在理解和分類圖像內容時存在局限性。雖然多模態數據融合技術已經提出,但傳統的融合方法,如數據級融合和決策級融合,無法充分挖掘不同模態數據之間的關聯和互補信息,影響了分類的準確性和魯棒性。

4、深度學習模型的高效訓練和優化也是一個關鍵問題。現有的深度學習框架,如tensorflow和pytorch,提供了強大的模型構建和訓練工具,但在大規模數據集上進行模型訓練時,計算資源的需求非常高。模型的超參數調優是一個復雜且耗時的過程,傳統的網格搜索和隨機搜索方法效率低下,難以在合理時間內找到最優的超參數組合。此外,深度學習模型的訓練通常依賴單機或單gpu,難以充分利用多gpu或分布式計算資源,影響了訓練效率和模型性能。

5、知識圖譜在圖像內容分類中的應用尚處于初步階段。現有的圖像分類方法主要依賴于數據驅動的深度學習模型,缺乏領域知識的支持。知識圖譜作為一種重要的知識表示和管理工具,能夠有效地組織和表達領域知識,為圖像內容分類提供豐富的上下文信息和邏輯關系。然而,將知識圖譜與圖像分類模型結合,利用圖神經網絡(gnn)將知識圖譜中的知識融入分類過程,仍然面臨許多技術挑戰。例如,如何高效地構建和維護大規模知識圖譜,如何在圖像分類模型中合理引入和利用知識圖譜,都是需要深入研究的問題。

6、最后,現有的圖像分類歸檔系統多為手動操作,自動化程度低,效率低下。傳統的圖像管理系統(ims)雖然能夠實現圖像的分類、存儲、檢索和歸檔,但往往需要大量的人工干預,難以應對海量圖像數據的處理需求。自動化工作流技術在一定程度上能夠提升處理效率,但仍需要進一步優化和改進,以實現全流程的自動化處理,從圖像預處理、特征提取、多模態融合、模型訓練、知識圖譜構建到圖像分類和自動歸檔,全面提升系統的智能化和自動化水平。

7、因此,如何提供一種圖片內容批量識別與自動分類歸檔的方法是本領域技術人員亟需解決的問題。

技術實現思路

1、本發明的一個目的在于提出一種圖片內容批量識別與自動分類歸檔的方法,本發明通過結合多模態融合數據、深度學習模型和知識圖譜技術,實現了圖像內容的高效識別與分類歸檔,提升了系統的智能化和自動化水平。

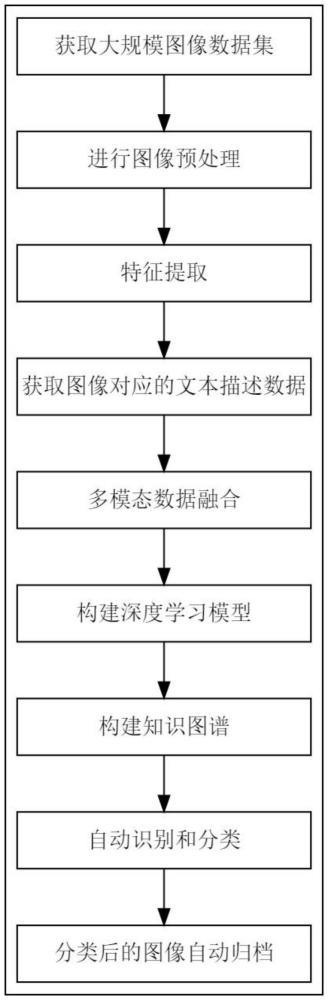

2、根據本發明實施例的一種圖片內容批量識別與自動分類歸檔的方法,包括如下步驟:

3、s1、獲取大規模圖像數據集;

4、s2、進行圖像預處理,包括圖像去噪、圖像增強和圖像分割;

5、s3、結合傳統特征提取方法和卷積神經網絡深度學習方法,對預處理后的圖像進行特征提取;

6、s4、獲取圖像對應的文本描述數據;

7、s5、將圖像特征和文本描述數據進行多模態數據融合,采用聯合嵌入模型和多模態變換器進行特征級融合;

8、s6、構建深度學習模型,利用分布式訓練技術和自動化超參數調優方法,對模型進行訓練和優化;

9、s7、利用知識圖譜技術構建知識圖譜,并與圖像分類模型結合,采用圖神經網絡進行知識驅動的圖像內容分類;

10、s8、基于訓練好的深度學習模型和知識圖譜,對圖像內容進行自動識別和分類;

11、s9、將分類后的圖像自動歸檔到相應的類別文件夾和數據庫中。

12、可選的,所述s3具體包括:

13、s31、使用sift算法對預處理后的圖像進行關鍵點檢測和描述符計算;在圖像的不同尺度空間內,檢測極值點作為關鍵點,計算關鍵點的主方向和局部圖像梯度直方圖,形成sift特征向量;sift特征向量計算公式為:

14、d(x,y,σ)=(g(x,y,kσ)-g(x,y,σ))*i(x,y);

15、其中,d(x,y,σ)表示尺度空間中的差分,g表示高斯函數,i表示輸入圖像,*表示卷積操作,σ表示尺度參數,k表示尺度空間中的比例因子;

16、s32、使用surf算法對圖像進行特征提取,在圖像的hessian矩陣行列式計算中檢測關鍵點;使用積分圖加速關鍵點檢測過程,計算關鍵點周圍的haar小波響應,并生成surf特征向量;所述hessian矩陣行列式的計算公式為:

17、

18、其中,l表示圖像的二階導數,xx、xy、yx和yy分別表示二階導數在不同方向上的計算;

19、s33、使用hog算法進行特征提取,將圖像劃分為若干個網格單元;在每個網格單元內計算梯度方向直方圖,形成hog特征向量;所述hog特征向量的計算公式為:

20、

21、其中,h(i,j)表示第i,j個單元的梯度直方圖,ix和iy分別表示圖像在x和y方向上的梯度;

22、s34、使用卷積神經網絡進行深度特征提取,構建由多個卷積層、池化層和全連接層組成的卷積神經網絡模型;將預處理后的圖像輸入到卷積神經網絡中,經過各層的卷積運算和非線性激活函數處理,提取圖像的深度特征;所述卷積運算的數學表達式為:

23、

24、其中,表示第k個卷積核在位置(i,j)處的輸出,σ為非線性激活函數,為第k個卷積核的權重,xi+m,j+n為輸入圖像在位置(i+m,j+n)處的像素值,bk為第k個卷積核的偏置;

25、s35、融合sift、surf、hog特征和卷積神經網絡提取的深度特征,形成多維度的圖像特征向量;

26、對sift、surf、hog特征進行標準化處理,使得各特征向量的量綱一致;

27、將標準化后sift、surt、hog特征與卷積神經網絡提取的深度特征進行拼接,形成最終的綜合特征向量:

28、v=[vsift,vsurf,vhog,vcnn];

29、其中,vsift,vsurf,vhog和vcnn分別表示sift、surf、hog和卷積神經網絡提取的特征向量;

30、s36、對所述綜合特征向量進行降維處理,采用主成分分析方法,計算綜合特征向量的協方差矩陣,對協方差矩陣進行特征值分解,選擇前k個特征值對應的特征向量作為主成分;將綜合特征向量投影到主成分空間,形成降維后的特征向量,數學表達式為:

31、y=vw;

32、其中,y表示降維后的特征向量,w為由前k個特征向量組成的變換矩陣。

33、可選的,所述s5具體包括:

34、s51、對圖像特征和文本描述數據進行預處理,確保數據格式一致且適合進行融合操作;

35、s52、對圖像特征進行歸一化處理,使特征值在相同范圍內,以便于后續的融合過程,歸一化處理公式為:

36、

37、其中,x為原始特征值,x′為歸一化后的特征值,min(x)和max(x)分別為特征值的最小值和最大值;

38、s53、對文本描述數據進行詞嵌入處理,使用預訓練的詞嵌入模型將文本描述轉化為向量表示,所述詞嵌入模型為word2vec;

39、s54、對詞嵌入向量進行降維處理,以減少數據維度并降低計算復雜度,所述降維方法包括主成分分析和t-sne;

40、s55、設計損失函數,采用聯合嵌入模型將圖像特征和文本特征進行特征級融合;

41、s56、采用多模態變換器進一步對圖像特征和文本特征進行深度融合,多模態變換器的輸入包括圖像特征向量和文本特征向量,通過自注意力機制對特征進行加權融合,公式如下:

42、

43、其中,q為查詢向量,k為鍵向量,v為值向量,dk為鍵向量的維度,z為加權融合后的特征向量;

44、s57、對融合后的特征向量進行歸一化處理和激活函數處理,采用relu激活函數,公式為:

45、f(x)=max(0,x);

46、其中,x為融合后的特征值,f(x)為激活后的特征值;

47、s58、將處理后的特征向量輸入到深度學習模型中,作為圖像內容分類的輸入特征。

48、可選的,所述損失函數表示為:

49、

50、其中,為圖像特征的分類損失,采用交叉熵損失計算,公式為:

51、

52、其中,n表示圖像樣本總數,yi表示第i個圖像樣本的真實標簽,表示第i個圖像樣本的預測概率;

53、為文本特征的分類損失,采用交叉熵損失計算,公式為:

54、

55、其中,m表示文本樣本的總數,yi表示第i個圖像樣本的真實標簽,表示第i個圖像樣本的預測概率;

56、為圖像特征和文本特征的對齊損失,采用余弦相似度損失計算,公式為:

57、

58、其中,表示圖像特征的向量表示,表示文本特征的向量表示;

59、為正則化損失,用于防止模型過擬合,公式為:

60、

61、其中,wk為模型的參數,λ為正則化參數;

62、α,β,γ,δ分別為各部分損失函數的權重系數。

63、可選的,所述s6具體包括:

64、s61、初始化深度學習模型,選擇卷積神經網絡和長短期記憶網絡作為基本架構,定義模型的輸入層、隱藏層和輸出層的結構;

65、s62、利用大規模圖像數據集對模型進行訓練,采用分布式訓練技術,將數據集分割成多個子集,分配到多個gpu或分布式計算節點上并行處理,提升訓練速度和效率;

66、s63、模型訓練過程中,使用隨機梯度下降優化算法對模型參數進行優化,設定初始學習率為α0,并采用學習率調度策略,根據訓練過程中的損失函數值動態調整學習率α,使其滿足:

67、

68、其中,β為學習率衰減因子,t為當前訓練輪數;

69、s64、采用批歸一化技術對每一批次的輸入數據進行標準化處理,使其滿足均值為0、方差為1,以加速訓練過程并提高模型的穩定性,具體操作如下:

70、

71、其中,x為輸入數據,μ為當前批次數據的均值,σ2為當前批次數據的方差,∈為避免分母為零的小值;

72、s65、引入正則化技術,在損失函數中添加l2正則化項,定義損失函數為:

73、

74、其中,ldata為數據損失項,λ為正則化強度因子,wi為模型參數,n為參數總數;

75、s66、采用網格搜索對模型的超參數進行自動化調優,定義超參數搜索空間,包括學習率、批次大小和隱藏層節點數,通過交叉驗證評估不同超參數組合的性能,選擇性能最優的組合;

76、s67、在訓練完成后,對模型進行驗證和測試,利用驗證集評估模型的性能,計算準確率、召回率和f1值指標,確保模型在測試集上的表現滿足預期要求;

77、s68、將訓練好的深度學習模型進行保存,包括模型結構和參數,保存格式采用pytorch的.pt文件,以便后續加載和使用。

78、可選的,所述s7具體包括:

79、s71、從相關領域的文獻、數據庫和專家知識中提取知識,利用自然語言處理技術進行知識抽取,包括實體識別、關系抽取和屬性抽取,對提取的知識進行結構化處理;

80、s72、將提取的知識表示為知識圖譜中的節點和邊,節點表示實體,邊表示實體之間的關系,屬性表示節點和邊的屬性信息,使用三元組(subject,predicate,object)形式表示知識;

81、s73、采用圖數據庫將知識圖譜存儲起來,確保知識的高效查詢和管理,使用查詢語言進行知識檢索和更新;

82、s74、根據領域知識構建初始知識圖譜,包含節點集合n和邊集合e,節點集合n表示實體,邊集合e表示實體之間的關系,初始知識圖譜記為g=(n,e);

83、s75、采用圖神經網絡對知識圖譜進行建模,構建gnn模型,其中輸入為知識圖譜g,輸出為節點的表示向量,通過迭代更新節點表示向量,捕捉圖結構和節點屬性信息;

84、s76、用訓練數據對gnn模型進行訓練,定義損失函數l,通過最小化損失函數l來優化模型參數,訓練過程中使用反向傳播算法和梯度下降方法更新模型參數,確保模型的收斂性和準確性;

85、s77、將訓練好的gnn模型與圖像分類模型結合,將圖像特征輸入到分類模型中,通過知識圖譜的節點表示向量增強圖像分類模型的特征表示能力,提升分類的準確性;

86、s78、利用知識圖譜中的節點表示向量和圖像分類模型,對輸入圖像進行分類,生成分類結果,分類結果根據知識圖譜中的關系進行解釋和推理,確保分類結果的可解釋性和可信度。

87、本發明的有益效果是:

88、(1)提高圖像預處理和特征提取效率:通過結合高斯濾波、直方圖均衡化和基于邊緣檢測的圖像分割技術,本發明能夠高效地對大規模圖像數據進行預處理,提升圖像質量。同時,結合傳統特征提取方法(sift、surf、hog)和卷積神經網絡(cnn)進行特征提取,實現了對圖像特征的多樣化和高效提取,確保在大規模圖像數據集上快速應用,提高特征提取的效率。

89、(2)多模態數據的深度融合:本發明通過獲取圖像對應的文本描述數據,利用聯合嵌入模型和多模態變換器進行特征級融合,將圖像特征和文本描述數據深度結合。該方法能夠有效挖掘不同模態數據之間的關聯和互補信息,提高圖像內容識別和分類的準確性和魯棒性,超越了傳統的簡單融合方法。

90、(3)深度學習模型的高效訓練和優化:構建的深度學習模型結合了卷積神經網絡(cnn)和長短期記憶網絡(lstm),采用分布式訓練技術在多gpu或分布式計算集群上進行訓練,并利用自動化超參數調優方法(如網格搜索、隨機搜索和貝葉斯優化)優化模型參數。通過這些方法,顯著提高了模型的訓練效率和分類效果,縮短了模型訓練時間,確保了模型的高性能和高準確性。

91、(4)知識圖譜在圖像內容分類中的應用:利用知識圖譜技術構建領域相關的知識圖譜,采用圖神經網絡(gnn)將知識圖譜與圖像分類模型結合。通過知識驅動的圖像內容分類,本發明能夠充分利用領域知識,提高分類的智能化和準確性。知識圖譜提供了豐富的上下文信息和邏輯關系,增強了分類模型的特征表示能力和分類效果。

92、(5)全流程自動化的分類歸檔系統:本發明設計了自動化工作流系統,涵蓋了圖像數據預處理、特征提取、多模態融合、深度學習訓練、知識圖譜構建和分類歸檔等模塊,實現了從圖像預處理到分類和歸檔的全流程自動化處理。通過自動分類和自動歸檔功能,顯著減少了人工干預,提高了系統的處理效率。

- 還沒有人留言評論。精彩留言會獲得點贊!