基于多模態尺度歸一化的視覺雷達聯合無人機定位方法

本發明屬于無人機,具體涉及基于多模態尺度歸一化的視覺雷達聯合無人機定位方法。

背景技術:

1、隨著無人機技術的發展,其續航、飛行速度、負載等多方面能力均得到了顯著提升,促進了其在農業灌溉、通信、交通運輸等方面的廣泛應用。然而,無人機技術發展帶來便利的同時,非法的無人機活動也帶來泄露隱私信息的風險,甚至會威脅重要基礎設施的安全。因此,在早期對未經授權的入侵無人機進行精確定位,對于防止無人飛行器破壞關鍵基礎設施和保護人身安全至關重要。

2、當前,無人機定位方法可以分為兩類,即基于單傳感器的方法和基于多傳感器模態融合的方法。基于單傳感器的方法如雷達,通過發射無線電波并分析反射信號的多普勒特性來定位目標。但這種方法容易受到和無人機有相似反射面的其他飛行目標的干擾,從而導致嚴重的虛警現象。基于單一視覺傳感器的無人機方法有較高的定位精度,并能進一步識別無人機和其他的飛行目標。但這種方法存在探測距離和視場方面的矛盾,限制了較近的工作范圍,且在無人機高機動性導致劇烈尺度變化時定位性能嚴重下降。

3、基于多傳感器模態融合的無人機定位方法因其高精度和強魯棒性而備受關注。guangyu?wu等人在其發表的論文“precise?uav?mmw-vision?positioning:amodal-oriented?self-tuning?fusion?framework”(ieee?j.sel.areas?commun.,vol.42,no.1,pp.6-20,jan.2024)提出了面向視覺和毫米波雷達的模態融合無人機定位系統,提升了復雜背景下無人機定位精度。但是受制于毫米波雷達的強衰減特性和光學設備的有限焦距,該系統的操作范圍被限制在100米內。sebastien?hengy等人在其發表的論文“multimodaluav?detection:study?of?various?intrusion?scenarios”(proc?spie?security&defense,warsaw,polan,oct.2017,pp.1-7)中聯合利用雷達、聲學、可見光和紅外傳感器以提升定位系統覆蓋范圍,并實現在煙霧、雜波或密集背景條件下的無人機定位,但其沒有考慮到無人機尺度變化對定位的影響,在遠距離無人機定位場景下的性能依然受限。svanstrm?fredrik等人在其發表的論文“real-time?drone?detection?and?trackingwith?visible,thermal?and?acoustic?sensors”(proc.25th?int.conf.patternrecognit.(icpr),milan,italy,jan.2021,pp.7265-7272)中使用聲學、紅外和多焦段的可見光傳感器融合實現無人機的定位,但當無人機距離增加導致實例尺度降低時該系統的定位性能顯著下降。

4、這些基于視覺傳感器融合的方法都僅有較近的探測距離,限制了實際無人機定位系統中決策的實施和部署。此外,目前無人機定位方法在遠距離情況下的定位精度很低,難以在實際無人機定位系統中應用。無人機高機動性導致的尺度劇烈變化是目前諸多定位方法都遇到的難題。因此,亟需開發新的無人機精確定位方法,以解決現有無人機識別技術在實際定位系統中探測距離受限、遠距離情況下定位精度低、尺度魯棒性差等問題。

技術實現思路

1、本發明所要解決的技術問題是針對上述現有技術的不足,提供基于多模態尺度歸一化的視覺雷達聯合無人機定位方法,利用雷達提供的距離信息作為無人機實例的尺度先驗,通過距離感知的圖像切片和尺度歸一化,將不同距離的無人機實例映射到相同的尺度空間,極大提升了廣域微小無人機的定位精度,增強了定位網絡對無人機尺度劇烈變化的魯棒性,而且能夠降低由鳥和其他飛行目標導致的虛檢。

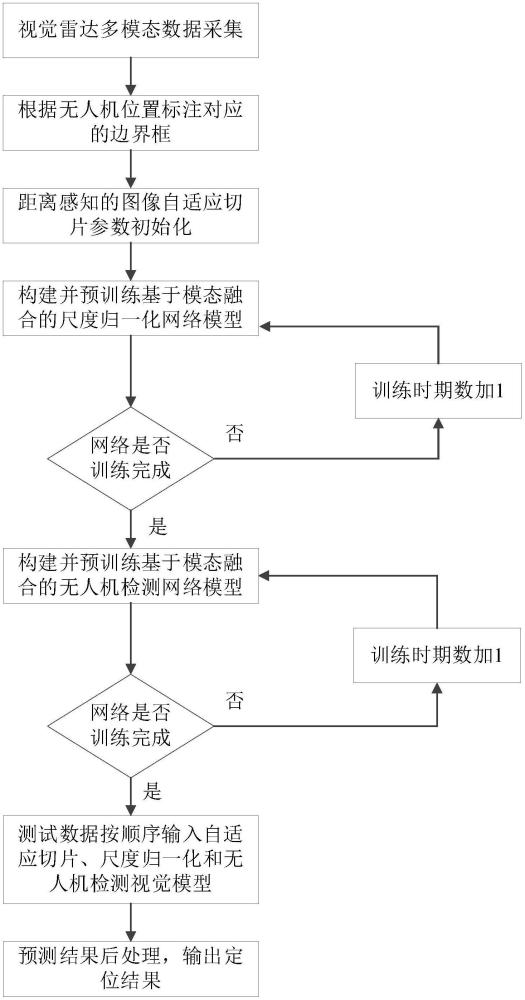

2、為實現上述技術目的,本發明采取的技術方案為:

3、基于多模態尺度歸一化的視覺雷達聯合無人機定位方法,包括:

4、步驟1:采集視覺雷達多模態數據,包括無人機圖像以及雷達提供的目標距離信息;

5、步驟2:根據無人機在圖像中的不同位置,標注對應的邊界框;

6、步驟3:采用距離感知的圖像自適應切片網絡,根據目標距離信息,將無人機圖像切片重組成批量二維圖像切片結構,得到訓練數據;

7、步驟4:構建基于模態融合的尺度歸一化網絡,并利用訓練數據訓練歸一化網絡;

8、步驟5:構建無人機定位視覺模型,并利用訓練數據訓練視覺模型;

9、步驟6:將測試無人機圖像以及目標距離信息輸入距離感知的圖像自適應切片網絡、基于模態融合的尺度歸一化網絡以及無人機定位視覺模型,得到預測結果后處理后,輸出定位結果。

10、為優化上述技術方案,采取的具體措施還包括:

11、上述的步驟1搭建一個由相控陣雷達和長焦相機組成的無人機定位系統,通過相控陣雷達提供的方位角引導長焦相機轉向目標方向進行拍攝,系統接收端捕獲無人機的圖像,以及雷達提供的目標距離信息。

12、上述的步驟3包括:

13、設置原始圖像i的寬度和高度分別為wi和hi;設置基準距離為d0,相應的圖像切片寬度和高度分別為w0和h0;設置基準上尺度因子r0以及重疊因子r0;

14、計算距離為di時相應的圖像切片寬度wi和高度hi:

15、

16、計算水平、垂直方向的切片數量mi、ni:

17、

18、其中,表示向上取整操作;

19、計算水平方向第m個切片和垂直方向第n個切片的邊界:

20、

21、

22、

23、

24、其中,m=1,2,…,mi,n=1,2,…,ni;表示向下取整操作;和分別表示相應切片窗口左上角和右上角在原圖上的坐標;

25、通過迭代m=1,2,…,mi,n=1,2,…,ni,實現切片窗口在原始圖像i上以重疊因子r0的連續滑動,保證整個圖像都被切片覆蓋,最終將無人機圖像切片重組成批量二維圖像切片結構并重新轉換無人機在切片中的邊界框。

26、上述的步驟4構建的基于模態融合的尺度歸一化網絡包括一個以雷達信息模態作為輸入的高階濾波器權重預測分支以及一個以圖像模態作為輸入的特征提取分支;基于模態融合的尺度歸一化網絡以前一步中獲得的不同低分辨率的圖像切片以及相應的雷達距離信息作為輸入,輸出相同高分辨率和一致尺度的無人機實例。

27、上述的以圖像模態作為輸入的特征提取分支包括淺層和深層特征提取模塊;

28、深層特征提取模塊包括一個用于輸入補丁中淺層特征提取的3×3卷積層,n個殘差swin?transformer基本塊和一個3×3卷積層;在每個殘差swin?transformer基本塊中,包括6個swin?transformerv2基本單元和一個3×3卷積層來執行特征提取;6個swintransformerv2基本單元被添加在多層感知機后對中間數據進行標準化;殘差swintransformer基本塊內部以及淺層、深層特征提取模塊之間添加殘差連接以進一步緩解梯度消失和爆炸問題,增強網絡的特征提取能力;采用一個1×1的卷積作為瓶頸層來聚合淺層和深層語義特征。

29、上述的以雷達信息模態作為輸入的高階濾波器權重預測分支,根據可變分步步長機制,輸出高分辨率圖像中的像素坐標(i′,j′)和相應的輸入圖像像素坐標(i,j)之間的關系:

30、

31、其中,ri=r0di/d0表示無人機距離為di時的圖像切片對應的上采樣因子;

32、按照下式構造坐標偏移矩陣pi:

33、

34、其中,d0為基準距離,r0為基準上尺度因子;

35、rup(i)=idir0/d0、rup(j)=jdir0/d0,且i∈{1,2,...,r0w0},j∈{1,2,...,r0h0},w0和h0分別為圖像切片寬度和高度。

36、上述的權重預測分支中,用一個256個隱藏神經單元的多層感知機執行權重預測過程,訓練過程中,采用的損失函數為:

37、l1-nrom(·)=||isr-igt||1

38、其中,isr、igt、||·||1分別為模型的預測數據、相應的真實數據以及l1范數。

39、上述的步驟5中,基于無人機定位的視覺模型架構,選擇預訓練的無人機定位視覺模型作為起點,進行遷移學習,或者從頭開始訓練一個新的無人機定位視覺模型;采用圖像切片和邊界框標簽作為輸入,訓練無人機定位視覺模型。

40、上述的步驟6包括:接收來自無人機定位系統中的測試無人機圖像和雷達提供的目標距離信息di;

41、根據距離信息di,動態調整圖像切片的大小和分辨率;

42、應用距離感知的圖像自適應切片網絡,將測試無人機圖像分割成多個重疊的補丁,每個補丁都包含無人機的一部分以及上下文信息,實現圖像切片中特征向量的提取;

43、將從圖像切片中提取的特征向量和雷達提供的目標距離信息di輸入到基于模態融合的尺度歸一化網絡中,對圖像補丁進行超分辨率處理,以生成具有統一尺度的高分辨率圖像;

44、將經過基于模態融合的尺度歸一化網絡的圖像補丁輸入到訓練好的無人機定位視覺模型中;

45、視覺定位模型對每個圖像補丁進行分析,識別并定位無人機的像素坐標,并輸出預測的邊界框和相應的置信度分數。

46、本發明具有以下有益效果:

47、1,本發明引入雷達模態信息作為無人機實例尺度的先驗知識,能夠緩解無人機尺度劇烈變化導致的定位性能損失。

48、2,本發明設計的基于模態融合的尺度歸一化網絡模型,能夠基于單一模型和雷達提供的距離信息實現無人機實例尺度歸一化,具有輕量化的特點。

49、3,本發明設計的多模態尺度歸一化的無人機定位方法能夠顯著提升定位模型的尺度魯棒性。

50、4,相比于傳統無人機定位方法,通過多模態尺度歸一化技術,有效緩解了尺度變化和復雜背景對無人機定位的影響,復雜背景和遠距離條件下的定位性能得到了明顯改善,有高定位精度和召回率的優勢。

- 還沒有人留言評論。精彩留言會獲得點贊!