文本分析模型的訓練方法以及文本匹配的方法與流程

本公開涉及數據處理,尤其涉及一種文本分析模型的訓練方法以及文本匹配的方法。

背景技術:

1、隨著信息技術的飛速發展和企業數字化轉型的深入,工單系統作為企業內部服務管理的重要組成部分,其智能化水平已成為衡量企業服務質量的關鍵指標之一。傳統的工單系統雖然在一定程度上提高了工作效率,但在處理客戶問題或請求時,仍依賴于人工操作和經驗判斷,導致響應速度慢、處理效率低、客戶滿意度不高等問題。

2、在智能工單系統的研發過程中,文本分析模型通過處理與用戶需求有關的文本,深入理解和識別用戶的各種需求,是智能工單系統的重要的處理環節。然而,現有的文本分析模型,尤其是在文本預處理和向量編碼階段,仍然存在一些局限性。首先,分詞系統的不完善導致無法準確處理歧義詞、識別新詞以及處理特殊文本,這些問題直接影響了文本信息的提取和后續處理的準確性。其次,向量編碼階段的問題主要體現在word2vec等模型無法有效學習句子信息,缺乏足夠的語料庫支持,導致編碼向量無法精確表達文本語義。此外,在人工標注數據的過程中,由于標注人員的專業素質不一,這會導致模型的識別精度受限。因此,目前的智能工單系統在處理工單數據時,尤其是專業性較強的工單數據,智能工單系統的文本分析模型識別精度較低,導致無法匹配到準確有效的解決方案文本。

技術實現思路

1、本公開提供了一種文本分析模型的訓練方法以及文本匹配的方法。其主要目的在于解決智能工單系統在檢索匹配解決方案文本時,由于文本分析模型的識別精度低,無法匹配到準確有效的解決方案文本的問題。

2、根據本公開的第一方面,提供了一種文本分析模型的訓練方法,包括:

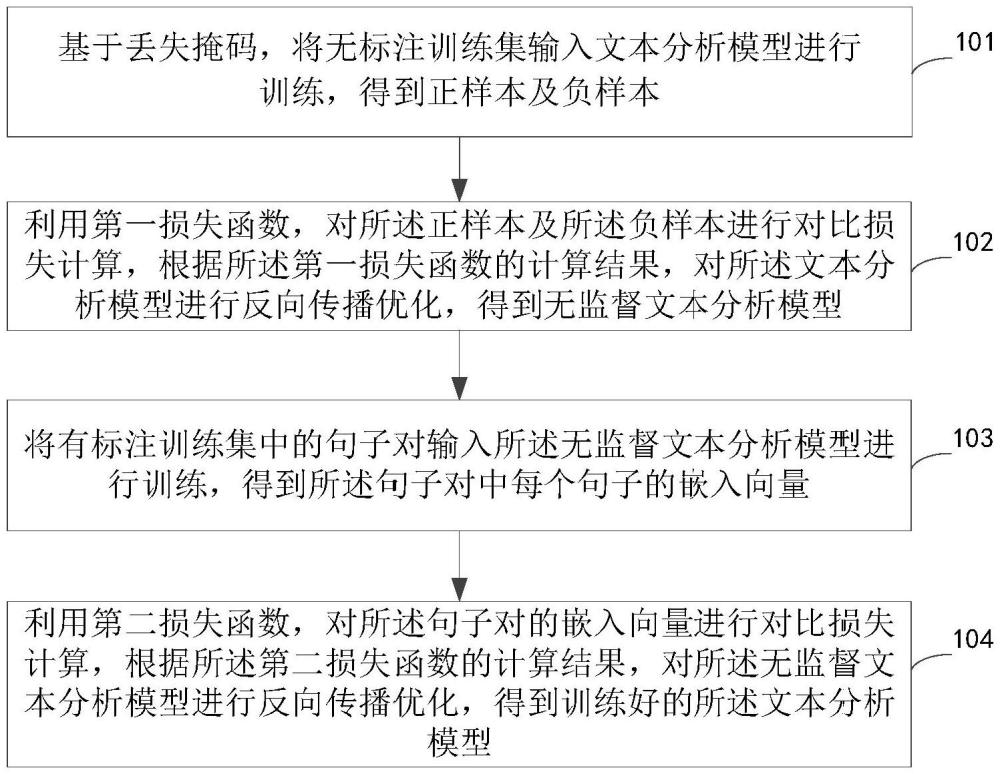

3、基于丟失掩碼,將無標注訓練集輸入文本分析模型進行訓練,得到正樣本及負樣本;

4、利用第一損失函數,對所述正樣本及所述負樣本進行對比損失計算,根據所述第一損失函數的計算結果,對所述文本分析模型進行反向傳播優化,得到無監督文本分析模型;

5、將有標注訓練集中的句子對輸入所述無監督文本分析模型進行訓練,得到所述句子對中每個句子的嵌入向量;

6、利用第二損失函數,對所述句子對的嵌入向量進行對比損失計算,根據所述第二損失函數的計算結果,對所述無監督文本分析模型進行反向傳播優化,得到訓練好的所述文本分析模型。

7、在一些實施例中,所述方法還包括:

8、基于所述第二損失函數的計算結果,將所述有標注訓練集中損失值超過損失閾值的句子對,并生成難樣本數據集;

9、將所述難樣本數據集輸入所述無監督文本分析模型進行訓練,得到訓練好的所述文本分析模型。

10、在一些實施例中,所述基于丟失掩碼,將無標注訓練集輸入文本分析模型進行訓練,得到正樣本及負樣本,包括:

11、基于第一數量的所述丟失掩碼,將所述無標注訓練集中的每個句子,輸入所述文本分析模型進行訓練,得到所述正樣本;

12、獲取所述無標注訓練集中同一批次的其他句子進行訓練得到的句子嵌入,并將所述句子嵌入標記為所述負樣本。

13、在一些實施例中,所述方法還包括:

14、基于注意力掩碼,對所述每個句子的編碼向量進行池化操作,以便將所述嵌入向量映射至同一維度;

15、所述基于注意力掩碼,對所述每個句子的編碼向量進行池化操作,包括:

16、獲取所述編碼向量,并將其賦值給標記嵌入向量;將輸入的所述注意力掩碼擴展成與所述編碼向量相同的形狀,得到擴展輸入掩碼;

17、將所述標記嵌入向量與所述擴展輸入掩碼進行加權求和處理,得到加權求和后的求和嵌入向量;

18、在所述求和嵌入向量的第一個維度上對所有元素求和,得到第一標量值;在所述擴展輸入掩碼的第一個維度上對所有元素求和,得到第二標量值;

19、將所述第一標量值及所述第二標量值相除,得到池化操作后的編碼向量。

20、在一些實施例中,在得到訓練好的所述文本分析模型之后,所述方法還包括:

21、基于采集到的增量學習數據集,對訓練好的所述文本分析模型進行增量學習訓練。

22、在一些實施例中,所述方法還包括:

23、基于預設評估方法及預設測試數據集,對訓練好的所述文本分析模型進行評估處理,得到模型評估結果。

24、根據本公開的第二方面,提供了一種文本匹配的方法,包括:

25、獲取待處理工單數據,并對所述待處理工單數據進行預處理,得到文本分析數據;

26、將所述文本分析數據輸入文本分析模型進行預測,得到所述文本分析數據對應的文本表達向量;

27、基于所述文本表達向量,檢索歷史工單數據庫中所述待處理工單數據對應的解決方案文本。

28、在一些實施例中,所述將所述文本分析數據輸入文本分析模型進行預測,得到所述文本分析數據對應的文本表達向量,包括:

29、對所述文本分析數據進行編碼處理,得到詞匯編碼向量,并對所述編碼向量進行填充,以便所述編碼向量的長度一致;

30、將所述詞匯編碼向量及注意力掩碼輸入所述文本分析模型進行預測,得到所述文本分析數據對應的文本嵌入向量;

31、對所述文本嵌入向量進行歸一化操作,得到所述文本分析數據對應的文本表達向量。

32、在一些實施例中,所述方法還包括:

33、對所述待處理工單進行數據分析,生成所述文本分析模型的增量學習數據集。

34、根據本公開的第三方面,提供了一種文本分析模型的訓練裝置,包括:

35、第一訓練單元,用于基于丟失掩碼,將無標注訓練集輸入文本分析模型進行訓練,得到正樣本及負樣本;

36、第一優化單元,用于利用第一損失函數,對所述正樣本及所述負樣本進行對比損失計算,根據所述第一損失函數的計算結果,對所述文本分析模型進行反向傳播優化,得到無監督文本分析模型;

37、第二訓練單元,用于將有標注訓練集中的句子對輸入所述無監督文本分析模型進行訓練,得到所述句子對中每個句子的嵌入向量;

38、第二優化單元,用于利用第二損失函數,對所述句子對的嵌入向量進行對比損失計算,根據所述第二損失函數的計算結果,對所述無監督文本分析模型進行反向傳播優化,得到訓練好的所述文本分析模型。

39、在一些實施例中,所述裝置還包括:

40、生成單元,用于基于所述第二損失函數的計算結果,將所述有標注訓練集中損失值超過損失閾值的句子對,并生成難樣本數據集;

41、第三訓練單元,用于將所述難樣本數據集輸入所述無監督文本分析模型進行訓練,得到訓練好的所述文本分析模型。

42、在一些實施例中,所述第一訓練單元包括:

43、訓練模塊,用于基于第一數量的所述丟失掩碼,將所述無標注訓練集中的每個句子,輸入所述文本分析模型進行訓練,得到所述正樣本;

44、獲取模塊,用于獲取所述無標注訓練集中同一批次的其他句子進行訓練得到的句子嵌入,并將所述句子嵌入標記為所述負樣本。

45、在一些實施例中,所述裝置還包括:

46、池化單元,用于基于注意力掩碼,對所述每個句子的編碼向量進行池化操作,以便將所述嵌入向量映射至同一維度;

47、所述池化單元包括:

48、擴展模塊,用于獲取所述編碼向量,并將其賦值給標記嵌入向量;將輸入的所述注意力掩碼擴展成與所述編碼向量相同的形狀,得到擴展輸入掩碼;

49、第一計算模塊,用于將所述標記嵌入向量與所述擴展輸入掩碼進行加權求和處理,得到加權求和后的求和嵌入向量;

50、第二計算模塊,用于在所述求和嵌入向量的第一個維度上對所有元素求和,得到第一標量值;在所述擴展輸入掩碼的第一個維度上對所有元素求和,得到第二標量值;

51、第三計算模塊,用于將所述第一標量值及所述第二標量值相除,得到池化操作后的編碼向量。

52、在一些實施例中,在得到訓練好的所述文本分析模型之后,所述裝置還包括:

53、第四訓練單元,用于基于采集到的增量學習數據集,對訓練好的所述文本分析模型進行增量學習訓練。

54、在一些實施例中,所述裝置還包括:

55、評估單元,用于基于預設評估裝置及預設測試數據集,對訓練好的所述文本分析模型進行評估處理,得到模型評估結果。

56、根據本公開的第四方面,提供了一種文本匹配的裝置,包括:

57、預處理單元,用于獲取待處理工單數據,并對所述待處理工單數據進行預處理,得到文本分析數據;

58、預測單元,用于將所述文本分析數據輸入文本分析模型進行預測,得到所述文本分析數據對應的文本表達向量;

59、檢索單元,用于基于所述文本表達向量,檢索歷史工單數據庫中所述待處理工單數據對應的解決方案文本。

60、在一些實施例中,所述預測單元包括:

61、編碼模塊,用于對所述文本分析數據進行編碼處理,得到詞匯編碼向量,并對所述編碼向量進行填充,以便所述編碼向量的長度一致;

62、預測模塊,用于將所述詞匯編碼向量及注意力掩碼輸入所述文本分析模型進行預測,得到所述文本分析數據對應的文本嵌入向量;

63、處理模塊,用于對所述文本嵌入向量進行歸一化操作,得到所述文本分析數據對應的文本表達向量。

64、在一些實施例中,所述裝置還包括:

65、分析單元,用于對所述待處理工單進行數據分析,生成所述文本分析模型的增量學習數據集。

66、根據本公開的第五方面,提供了一種電子設備,包括:

67、至少一個處理器;以及

68、與所述至少一個處理器通信連接的存儲器;其中,

69、所述存儲器存儲有可被所述至少一個處理器執行的指令,所述指令被所述至少一個處理器執行,以使所述至少一個處理器能夠執行前述第一方面或第二方面所述的方法。

70、根據本公開的第六方面,提供了一種存儲有計算機指令的非瞬時計算機可讀存儲介質,其中,所述計算機指令用于使所述計算機執行前述第一方面或第二方面所述的方法。

71、根據本公開的第七方面,提供了一種計算機程序產品,包括計算機程序,所述計算機程序在被處理器執行時實現如前述第一方面或第二方面所述的方法。

72、本公開提供了一種文本分析模型的訓練方法以及文本匹配的方法,基于丟失掩碼,將無標注訓練集輸入文本分析模型進行訓練,得到正樣本及負樣本;利用第一損失函數,對所述正樣本及所述負樣本進行對比損失計算,根據所述第一損失函數的計算結果,對所述文本分析模型進行反向傳播優化,得到無監督文本分析模型;將有標注訓練集中的句子對輸入所述無監督文本分析模型進行訓練,得到所述句子對中每個句子的嵌入向量;利用第二損失函數,對所述句子對的嵌入向量進行對比損失計算,根據所述第二損失函數的計算結果,對所述無監督文本分析模型進行反向傳播優化,得到訓練好的所述文本分析模型。與相關技術相比,本公開實施例通過使用丟失掩碼和第一損失函數進行對比損失計算,可以在無標注數據上進行無監督學習,從而學習到文本數據的特征和表示,這有助于提高文本分析模型對數據的理解和泛化能力;通過使用有標注數據集中的句子對進行有監督微調,可以進一步優化模型在特定任務上的性能,有監督微調可以幫助模型更好地適應任務需求,提高準確性和泛化能力。結合無監督學習和有監督微調的方法可以提高模型的泛化能力,使文本分析模型在未見過的數據上表現更好。

73、應當理解,本部分所描述的內容并非旨在標識本技術的實施例的關鍵或重要特征,也不用于限制本技術的范圍。本技術的其它特征將通過以下的說明書而變得容易理解。

- 還沒有人留言評論。精彩留言會獲得點贊!