一種基于模態自適應掩碼融合網絡的多模態情感識別方法

本發明涉及語音情感識別技術,特別是涉及一種基于模態自適應掩碼融合網絡的多模態情感識別方法。

背景技術:

1、在人工智能快速發展的背景下,語音情感識別(speech?emotion?recognition,ser)已經成為一項重要研究方向。尤其在人機交互中,先進的情感識別技術不僅能提高系統的智能化,還能改善用戶體驗。此外,語音情感識別在心理健康分析、客戶服務等多個應用場景均展現出巨大潛力。

2、語音情感的傳遞與理解是一個非線性動態多層面交互的復雜過程,語音情感的細微差異無法單靠語音或文本進行全面展示。在交流過程中,人類通過多維信息來準確地傳達自己的感情狀態,例如語音中的語調、語速和文本中的詞匯選擇、句式結構。當前,語音情感識別研究逐步轉向多模態模型,通過集成語音、文本等多種感知模態,多層次、多角度捕捉人類語音情感的多維屬性,克服單模態語音情感識別技術受限于片面信息源,容易收到外部因素干擾和個體表達方式差異的影響。

3、跨模態?transformer?在音頻和文本的多模態信息融合中展現了強大的潛力。通過自注意力機制,跨模態?transformer?能夠有效地捕捉和建模音頻和文本之間的復雜關系和相互依賴性。例如,audiobert和speechbert等模型在音頻和文本融合任務中取得了顯著進展。這些模型利用?transformer?的自注意力機制,分別處理音頻和文本數據,并通過交叉注意力層將兩種模態的信息融合在一起,從而生成聯合表征。這些聯合表征能夠使模型更好地理解和處理多模態數據,提高在語音識別、語音翻譯和情感分析等任務中的性能。此外,li?et?al.提出的?vl-bert?模型通過在大規模多模態數據上進行預訓練,使語言和音頻等多種模態的表征對齊,進一步提升了多模態任務的表現。

4、掩碼自編碼器(mae)在文本和音頻領域的自監督學習中發揮了重要作用。其核心思想是掩蓋部分輸入數據,并訓練模型重建這些缺失部分,從而學習到有效的表征。在文本領域,bert掩蓋部分輸入詞匯,并訓練模型預測這些掩碼詞匯,從而獲得魯棒的語言表征,顯著提升了各種自然語言處理任務的性能,如問答、文本分類和命名實體識別等。在音頻領域,掩碼自編碼器也被用來處理語音數據。例如,tera模型通過掩蓋音頻幀并訓練模型重建這些幀,學習到豐富的音頻表征,該方法在語音識別等任務中表現優異。掩碼自編碼器不僅在單模態下表現出色,還可以與其他技術結合使用,能夠進一步增強表示學習的質量。利用了掩碼自編碼器的重建能力和對比學習的判別能力,從而在下游任務中實現更優的性能。

5、目前,多模態語音情感識別面臨的主要挑戰在于不同模態(語音和文本)的時間序列特性和表現方式存在差異,導致數據融合高度復雜。因此需要設計和優化數據融合策略,使這些異質信息流有機結合,協同發揮作用,確保系統在語音情感分析方面的精確性與靈敏度。現有研究內容如:mustaqeem?khan等人設計出一種新穎的多模態語音情感識別模型,利用多頭交叉注意力機制完成語音和文本編碼器的特征融合,實現不同層和分支之間的跨模態交互,提升了整體模型的泛化能力。guan-nan?dong等人提出了一個用于多模態言語情感識別的時態關系推理網絡trin,在多模態融合過程中,該網絡結合每個模態時態推理生成的時序結構全局信息,完成了跨模態特征的時序對齊,并采用自適應機制選擇模態之間的隱式互補信息,以增強子空間之間的依賴關系,實現更為細致的模態融合。zheng?lian[6]等人設計了一種基于半監督的多模態語音情感分析網絡smin。在半監督學習的框架下,模型通過模態內交互和跨模態交互模塊,提取單一模態內的關鍵信息,并完成不同模態間的信息處理和整合。

6、然而,當前方法存在以下問題:在語音和文本進行多模態融合時,通常使用兩類特征提取器來提取特征,并在特征交互或混合前進行特征對齊,保持不同模態的特征維度一致。然而,由于文本和語音模態的特征維度和信息密度存在差異,語音特征具有較高的時間分辨率和豐富的聲學信息,文本特征則具有更高的語義密度。在對齊過程中,以上操作可能導致高信息密度模態的信息損失。

7、需要說明的是,在上述背景技術部分公開的信息僅用于對本技術的背景的理解,因此可以包括不構成對本領域普通技術人員已知的現有技術的信息。

技術實現思路

1、本發明的主要目的在于解決上述背景技術中存在的問題,提供一種基于模態自適應掩碼融合網絡的多模態情感識別方法。

2、為實現上述目的,本發明采用以下技術方案:

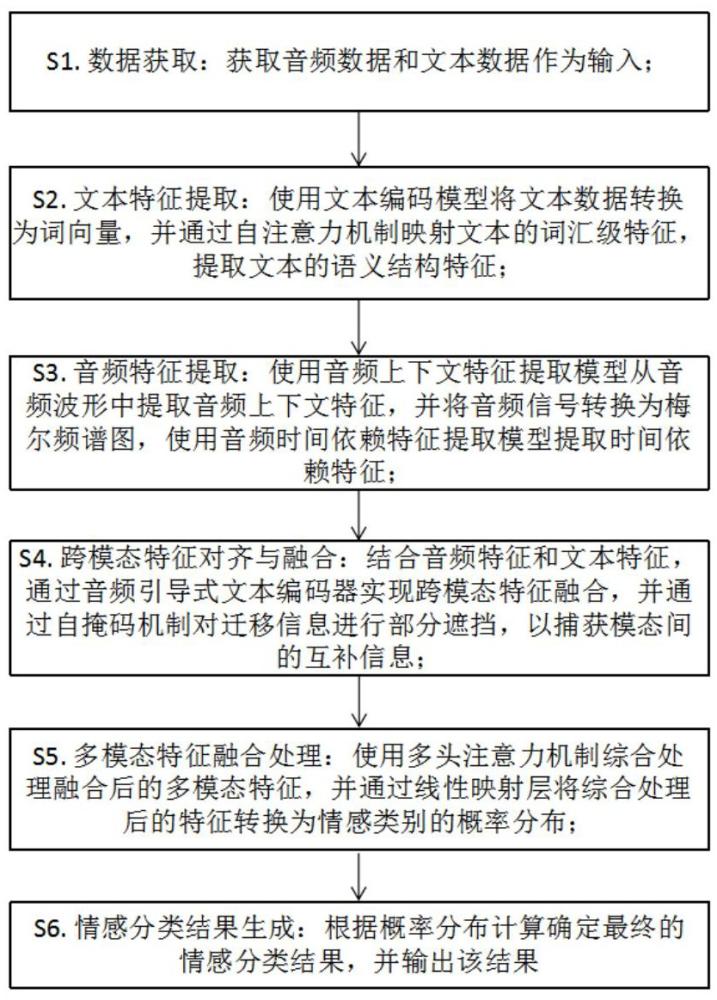

3、一種基于模態自適應掩碼融合網絡的多模態情感識別方法,包括以下步驟:

4、s1.?數據獲取:獲取音頻數據和文本數據作為輸入;

5、s2.?文本特征提取:使用文本編碼模型將文本數據轉換為詞向量,并通過自注意力機制映射文本的詞匯級特征,提取文本的語義結構特征;

6、s3.?音頻特征提取:使用音頻上下文特征提取模型從原始音頻波形中提取音頻上下文特征,并將音頻信號轉換為梅爾頻譜圖,使用音頻時間依賴特征提取模型提取時間依賴特征;

7、s4.?跨模態特征對齊與融合:結合音頻特征和文本特征,通過音頻引導式文本編碼器實現跨模態特征融合,并通過自掩碼機制對遷移信息進行部分遮擋,以捕獲模態間的互補信息;

8、s5.?多模態特征融合處理:使用多頭注意力機制綜合處理融合后的多模態特征,并通過線性映射層將綜合處理后的特征轉換為情感類別的概率分布;

9、s6.?情感分類結果生成:根據概率分布計算確定最終的情感分類結果,并輸出該結果。

10、一種計算機可讀存儲介質,存儲有計算機程序,所述計算機程序由處理器執行時實現所述的基于模態自適應掩碼融合網絡的多模態情感識別方法。

11、一種計算機程序產品,包括計算機程序,所述計算機程序由處理器執行時實現所述的基于模態自適應掩碼融合網絡的多模態情感識別方法。

12、本發明具有如下有益效果:

13、本發明提出了一種創新的多模態情感識別方法,該方法基于所設計的模態自適應掩碼融合網絡mamf-net,有效解決了傳統多模態融合中存在的信息丟失和跨模態對齊問題。mamf-net通過音頻引導式文本編碼器,利用語音信號的時間分辨率和上下文信息,增強了文本的語義表示,確保了不同模態特征在維度和信息密度上更加精準的對齊。此外,模型采用自掩碼機制的遮擋策略,針對跨模態知識遷移過程中可能出現的信息同質性問題,通過部分遮擋遷移信息,促進了模態間的互補信息捕獲,從而提升了融合效果和系統穩定性。本發明的mamf-net在情感識別任務中的顯著性能提升得益于其對模態間信息的高效整合能力。實驗結果在cmu-mosi、cmu-mosei和ch-sims等數據集上均表明mamf-net優于現有方法,驗證了其在多模態情感分析中的高效整合能力和廣泛應用潛力,為情感識別任務提供了一種準確和魯棒的解決方案。

14、本發明實施例中的其他有益效果將在下文中進一步述及。

- 還沒有人留言評論。精彩留言會獲得點贊!